Moderation

Content-Moderation bezeichnet die Überprüfung von nutzereingebenen sowie von Agent:innen generierten Inhalten auf Elemente wie Pornografie, Gewalt und Ähnliches. Ziel ist es, die Gesundheit und Sicherheit der Inhalte zu gewährleisten und Compliance-Risiken für Kund:innen zu minimieren. Content Moderation ist damit ein zentraler Bestandteil moderner IT-Lösungen.

Service

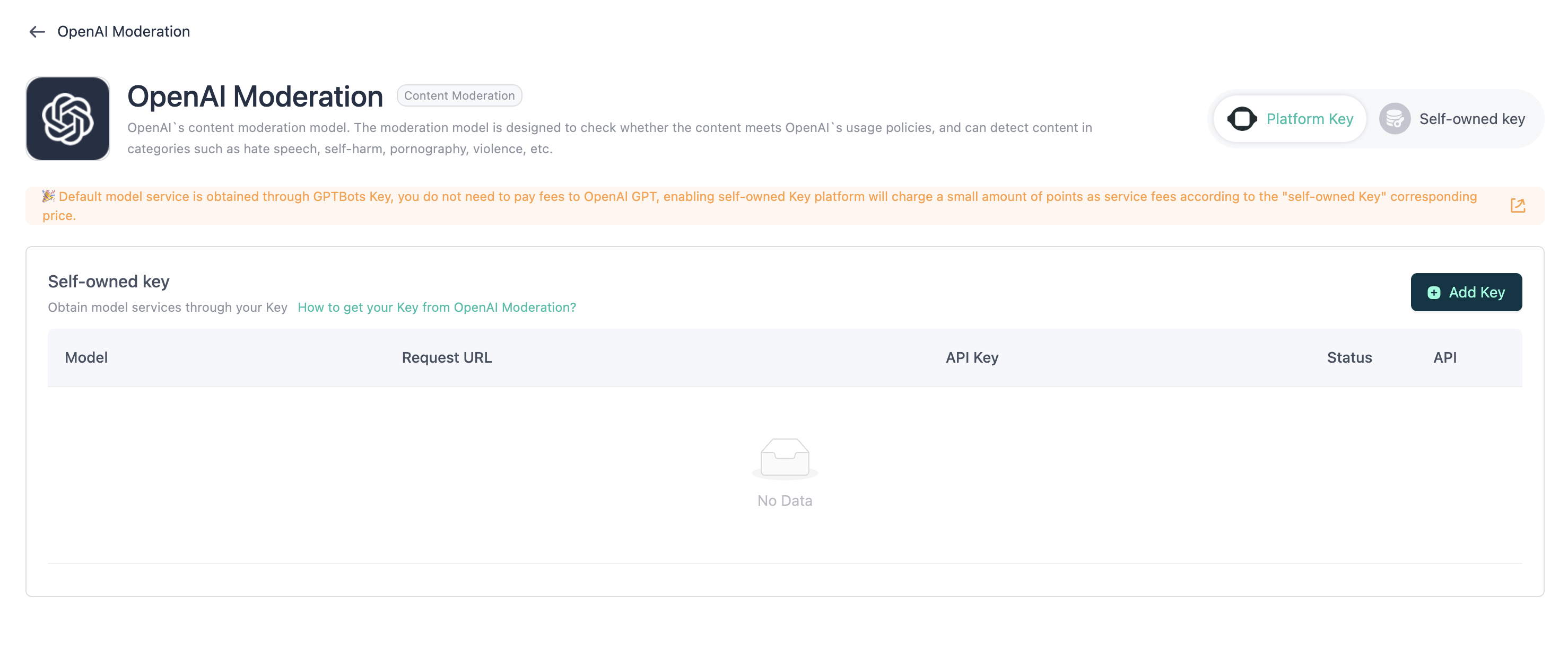

Aktuell wird OpenAI Moderation unterstützt.

Zentrale Konfiguration

- GPTBots Key: Mit diesem Schlüssel können Nutzer:innen den Content-Moderation-Service direkt über GPTBots nutzen. Eine separate Integration mit OpenAI ist nicht erforderlich.

- Mein Key: Alternativ können Nutzer:innen ihren eigenen OpenAI Key verwenden, um auf den jeweiligen Content-Moderation-Service zuzugreifen.

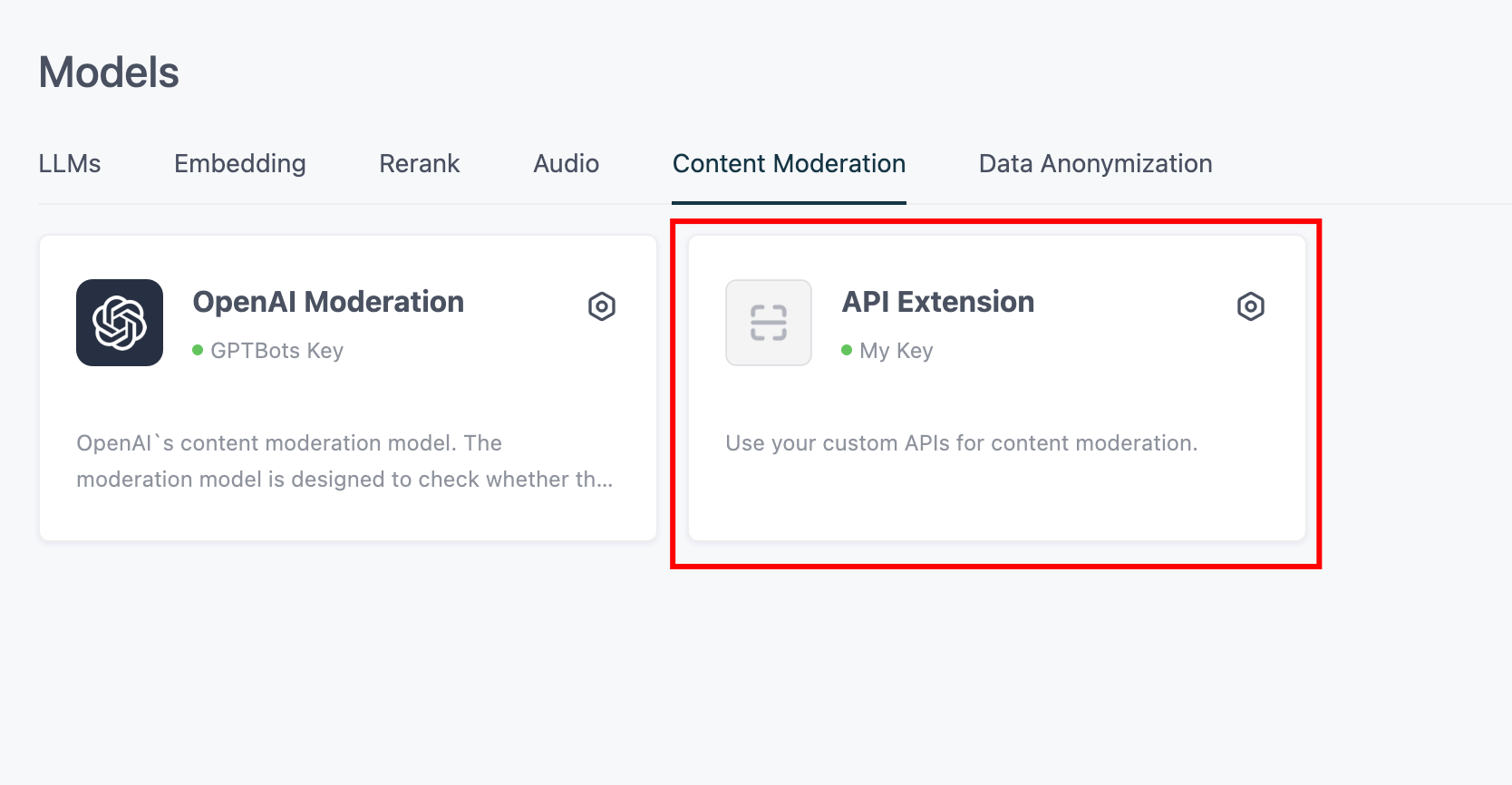

API-Erweiterung

Wenn Sie Moderationsdienste anderer Anbieter nutzen möchten, können Sie mithilfe der unten beschriebenen Methode eine benutzerdefinierte API-Erweiterung integrieren.

API-Entwicklung

Um eine eigene API für die Content-Moderation zu verwenden, muss die API folgende Anforderungen erfüllen:

- Unterstützung von

Bearer-Authentifizierung - Verwendung der

POST-Methode

Der Request-Body muss folgende Struktur aufweisen:

{

"point": "agent.moderation.input",

"params": {

"agent_id": "66dacfb60d3bb525b33e7b2b",

"query": [

{

"type": "text",

"text": "...zu klassifizierender Text..."

},

{

"type": "image",

"url": "https://example.com/image.png"

}

]

}

}

| Feld | Typ | Beschreibung |

|---|---|---|

| point | String | Der Moderations-Endpunkt. Für Input-Moderation verwenden Sie agent.moderation.input. Für Output-Moderation verwenden Sie agent.moderation.output. |

| params | Objekt | Dieses Parameterobjekt enthält die Details der Moderationsanfrage. |

| - agent_id | String | Die ID des zu moderierenden Agenten. |

| - query | Array | Die zu moderierenden Inhalte. |

| - - type | String | Der Inhaltstyp: text, image. |

| - - text | String | Falls der Typ text ist, enthält dieser Parameter den zu moderierenden Text. |

| - - url | String | Falls der Typ image ist, enthält dieser Parameter die URL des Bildes. |

Der Response-Body muss folgende Struktur haben:

{

"flagged": true,

"preset_response": "Ihr Inhalt verstößt gegen unsere Nutzungsrichtlinien."

}

| Feld | Typ | Beschreibung |

|---|---|---|

| flagged | Bool | Gibt das Moderationsergebnis an, ob der Inhalt die Prüfung bestanden hat. true bedeutet nicht bestanden, false bedeutet bestanden. |

| preset_response | String | Falls das Moderationsergebnis nicht bestanden ist, wird dieser Text als Antwort an die Nutzer:innen verwendet. |

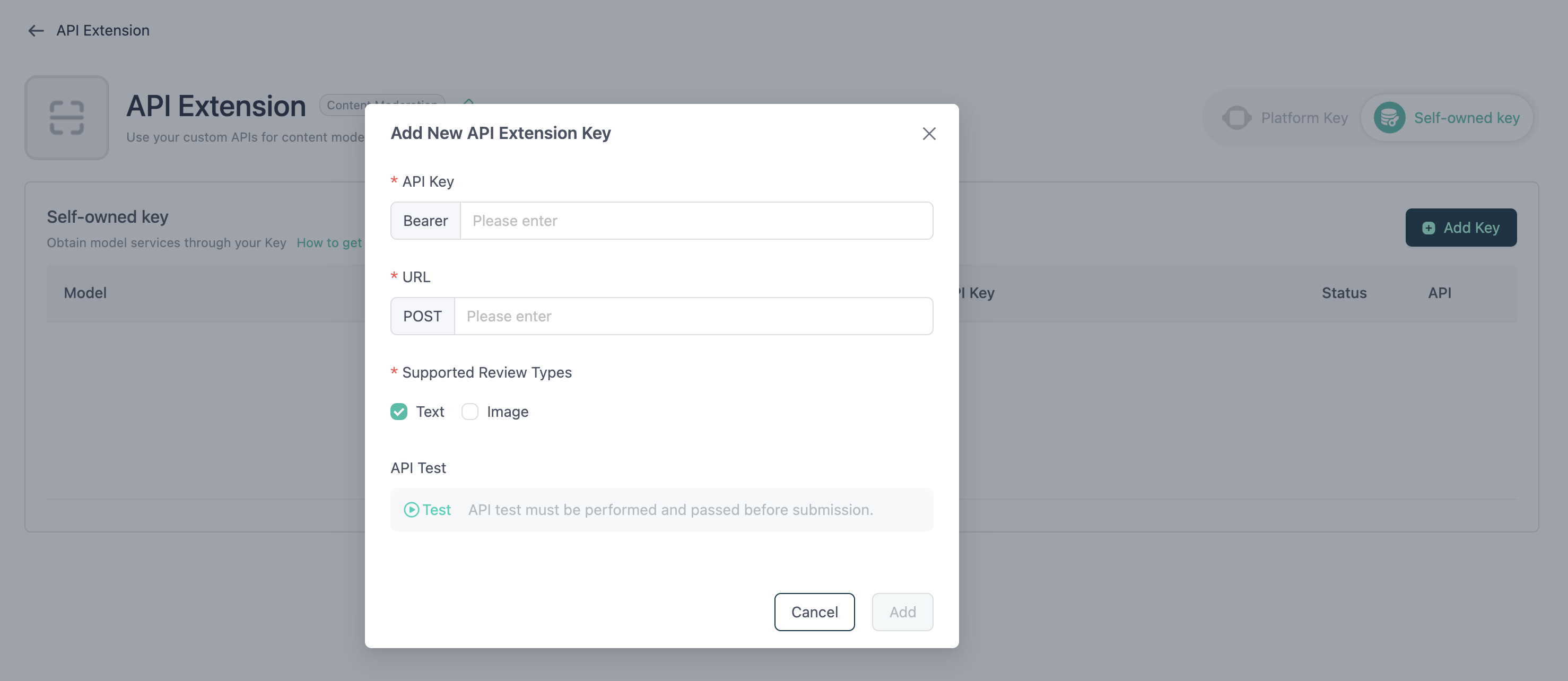

API hinzufügen

Klicken Sie auf „Neue API-Erweiterung“.

Konfigurieren Sie die Informationen der erweiterten API im Panel und klicken Sie auf „Testen“.

Wenn der Test erfolgreich ist, klicken Sie auf „Speichern“. Die API-Erweiterung ist damit aktiv.